AI相关开发

AI相关开发

ZEROKO14AI相关工具和技术盘点

基本术语

向量数据库: CloseVector

LLM:大语言模型

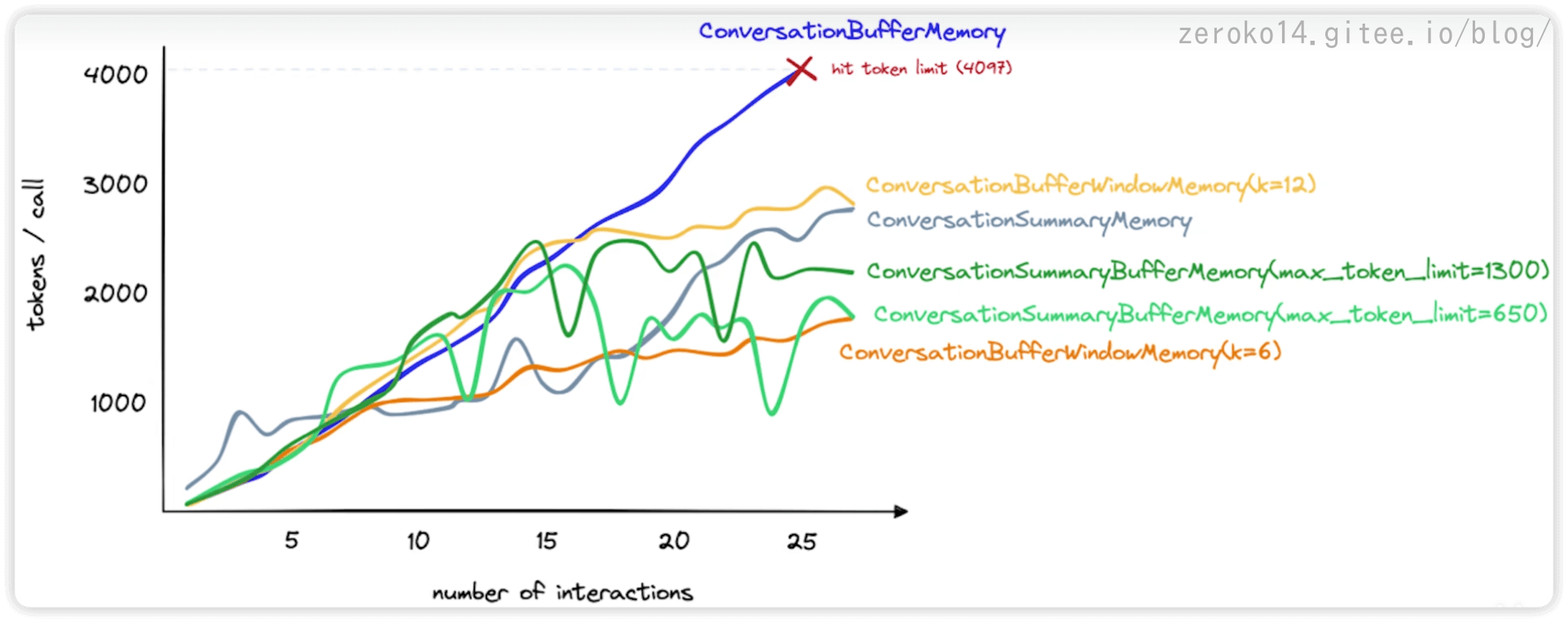

介绍几种联系上下文的方式

下面均以langchain为例

Buffer Memory

存储每段对话作为LLM的新输入

Conversation Sumary Momory

将对话信息传给LLM进行摘要,将此摘要作为开头部分传入LLM

Conversation Buffer Window Memory

将最近的k组对话存储起来,作为下一轮的LLM的输入

Conversation Summary Buffer Memory

第2种和第3种方式的结合,将最近的k组对话存储起来以及[上一轮的摘要+老k组对话]的摘要+新k组对话,作为下一轮的LLM的输入(使用token长度来决定什么时候刷新输入)

优点,不仅有短期记忆,也有长期记忆

entity memory

通过LLM提取对话中有关实体的知识并积累

vector store back memory或思维导图记忆方式

向量数据库匹配或思维导图记忆方式

对长文本做总结的方式

下面均以langchain为例

stuff模式

直接将document传给LLM做总结

map_reduce模式

分割多个片段,通过LLM对每个片段进行总结,再将总结拼接再交给LLM总结

refine模式

分割多个片段,先对第一个片段进行总结,再将前一个片段的总结加上下一个片段进行总结,以此总结递推直到只有一个总结

优点:增加了总结内容的连贯性

map_rerank模式

一种搜索答案的匹配方式

根据一个问题,给每个document片段计算一个能回答这个问题的概率分数,然后找到分数最高的document片段,将其转换为问题的一部分,加问题发送给LLM

- 想获得更综合性的知识:使用refine或map_reduce模式

- 获取更精确的细节知识:使用map_rerank模式

爬虫相关

无头浏览器

无头浏览器是一种不带图形用户界面 (GUI) 的网络浏览器。这意味着它不会显示任何窗口或菜单,而是将其所有输出发送到文本终端或其他输出设备。

无头浏览器通常用于自动化测试和网络抓取,因为它们可以通过编程控制,并且不需要任何用户交互。 有许多不同的无头浏览器可用,包括 PhantomJS、SlimerJS 和 Puppeteer。

这些浏览器都有自己的优点和缺点,因此选择最适合您需求的浏览器非常重要。 无头浏览器可以成为自动化网络任务的有用工具,但必须负责任地使用它们。无头浏览器可以用于爬取网站并提取数据,但也可以用于发起拒绝服务攻击。

现成的ai爬虫项目

本质是利用无头浏览器实现

1 | type Config = { |

实例:

1 | import { Config } from "./src/config"; |

.desc-info-text :b站简介

.video-title :b站标题

.reply-content :b站评论

PlaywrightCrawler

是一个用于爬取网站数据的工具,它是基于Playwright库构建的,可以模拟浏览器行为来爬取网页内容。这个错误可能是由于超时设置或选择器的问题导致的。

SeleniumCrawler

gemini正确的回复如下:

1 | { |

gemini有效的提示

获取格式化后的时间

1 | 现在时间是2024年1月10日14:33,请将接下来这句话提取出具体的时间和具体提醒项,按照"xxxx年xx月xx日xx:xx|做什么事"回复给我: |

ts的定时库:node-cron

总结精炼

1 | 用中文总结精炼这段网页信息的重点内容: |

1 | docker run -ti --rm --volume="$(pwd)":/share/homes/zeroko14/bot wechaty/wechaty /share/homes/zeroko14/bot/bot.ts |

本地大模型

Ollama

相关命令

展示本地大模型列表:

ollama list删除单个本地大模型:

ollama rm 本地模型名称启动本地模型:

ollama run 本地模型名查看本地运行中模型列表:

ollama ps复制本地大模型:

ollama cp 本地存在的模型名 新复制模型名下载或者更新本地大模型:

ollama pull 本地/远程仓库模型名称模型名称格式为:模型名称:参数规格;如

ollama pull qwen2:0.5b

终端对话中命令

- 若需要输入多行文本,需要用三引号包裹,如:

"""这里是多行文本""" /clear清除对话上下文信息/bye则退出对话窗口/set parameter num_ctx 4096可设置窗口大小为 4096 个 Token,也可以通过请求设置,如:curl <http://localhost:11434/api/generate> -d '{ "model": "qwen2:7b", "prompt": "Why is the sky blue?", "options": { "num_ctx": 4096 }}'/show info可以查看当前模型详情:- 启动服务:

ollama serve

API接口

Ollama 默认提供了generate和chat这 2 个原始的 API 接口,使用方式如下:

generate接口的使用样例:1

2

3

4curl http://localhost:11434/api/generate -d "{

'model': 'qwen:0.5b',

'prompt': '为什么天空是蓝色的?'

}"chat接口的使用样例:1

2

3

4

5

6curl http://localhost:11434/api/chat -d '{

"model": "qwen:7b",

"messages": [

{ "role": "user", "content": "为什么天空是蓝色的?" }

]

}'

盘点某些本地大模型

qwen2.5-coder模型

qwen2.5-coder

修改本地模型上下文

创建一个修改了上下文长度的本地大模型,因为默认的上下文都非常短

创建文件Qwen2.5Coder

1 | FROM qwen2.5-coder:7b |

ollama create -f Qwen2.5Coder qwen2.5-coder-ottodev:7b

Qwen2.5Coder就是指的上面的文件

curl模型测试命令

claude协议版本

1 | 获取模型支持的model |

openai协议版本

1 | 获取模型支持的model |

Aider

安装方式: python -m pip install aider-chat

/add 文件名:指定编写的代码写入哪个文件/drop:解除与文件的联系/quit退出程序- {多行文本问答}

更新方式: pip install --upgrade aider-chat

vscode aide拓展

配套Aider使用

One-api

可以把多种ai模型接口统一为openai格式

注意类openai通信协议中所有的base格式不用写后面的v1及其后续内容

执行命令docker run --name one-api -d --restart always -p 3000:3000 -e TZ=Asia/Shanghai -v /Users/zeroko/Documents/one-api:/data justsong/one-api

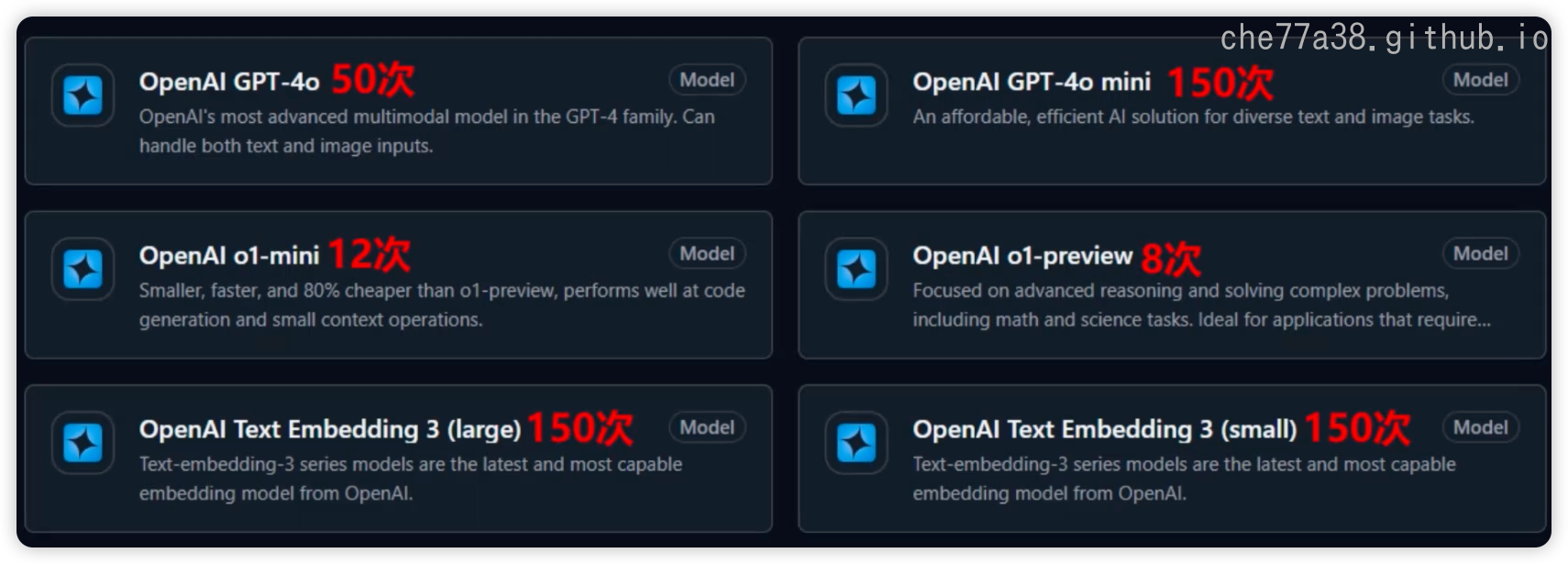

免费API平台盘点

Groke 注意,支持Whisper Large V3 Turbo等模型,音频转文字,音频文件需小于25MB,以及视觉识别模型

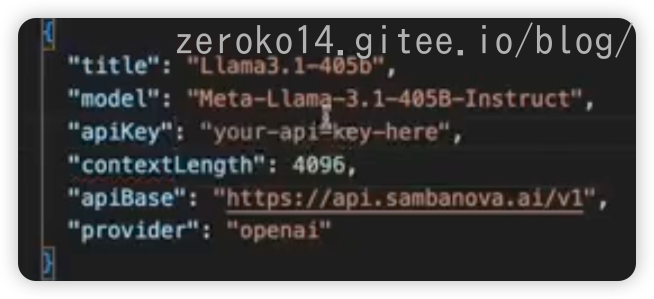

SambaNova 带速率限制的免费版本,亮点:提供llama-3.1-405b模型调用

Vertex 绑定信用卡300美金,不绑定150美金额度 参考此处

Cerebras 使用频率限制比Groke宽松,每分钟30个,每小时900个 特色:在线对话支持语音对话 需要申请 用法记录

Mistral 每秒一次请求,其中最强的模型性能与gemini flask持平

grok 每月25美金 官方地址

GLHF 测试阶段完全免费使用,没有任何限制,支持所有开源模型,Hugging Face所有开源模型,理论上包含DeepSeek V2模型,但是实际上跑不起来,自定义运行功能效果不好 地址

白嫖Groq API教程 2024末前两个月每月25美金

github models上的模型可以通过litellm来免费使用 参考视频

Open Router提供了Gemini2.0 Flash免费API 以及 DeepSeekV3的免费api

any router 可申请calude api 新人送50美金额度

SuperMaven

免费实现自动补全,响应非常快

cline

apiBase的配置是到v1前一层(即看不到v1),比如说deepseek的apiBase: https://api.deepseek.com

Continue

vscode ai对话拓展

配置格式参考

注意apiBase的设置到v1那一层

litellm

自动负载均衡:当请求发送给

minimax-m2.1时,LiteLLM 的 Router 会发现数据库里有两个 ID 为minimax-m2.1的后端配置,它会自动在两者之间进行负载均衡

负载均衡配置多模型优先级

- 在 Models + Endpoints 列表页。

- 找到你的

minimax-m2.1模型(也就是你刚才改名的那两个),点击右侧的 编辑图标(✏️ 铅笔形状) - 在弹出的编辑窗口中,寻找名为 “Model JSON”、“Advanced” 或者 “Configuration” 的区域

- LiteLLM UI 的不同版本界面略有不同,但通常都会提供一个可以直接修改 JSON 的输入框

- 在 JSON 配置中,找到

litellm_params字段(如果没有,就加在最外层,或者确保它在参数对象里) - 加入

"priority": 0

1 | { |

当一个请求进来时,LiteLLM 的 Router 会按照以下步骤执行:

- 第一层:优先级筛选 (Priority Check) 系统首先检查所有叫

minimax-m2.1的模型。它会锁定在当前可用的最高优先级(比如priority: 0)的那一组模型上。- 此时,你的 OpenRouter 模型(

priority: 1)直接被排除在外,根本不参与接下来的负载均衡计算。

- 此时,你的 OpenRouter 模型(

- 第二层:策略选择 (Routing Strategy) 在锁定的这组

priority: 0的模型(即你的两个内网模型)中,系统会根据你配置的least-busy策略进行选择。- 系统会比较这两个内网模型当前谁正在处理的请求更少,然后把新请求发给比较“闲”的那个。

故障切换 (Failover)

- 如果内网模型 A 和 B 都挂了(比如超时、返回 500 错误),LiteLLM 将它们标记为 Unhealthy。

- 此时 Priority 0 组全军覆没。

- Router 降级 到 Priority 1 组。

- 结果:请求发给 OpenRouter。

github models转换为类openai接口

1 | export GITHUB_API_KEY=xxxxxxx |

将显示作为代理的Base URL,模型设置为gpt-4o

AI请求反代服务器

上述项目支持Groq,Google,OpenAI,sambanova,Cerebras

但实测似乎只支持python调用,而不支持api调用?

下面反向代理项目支持一切

访问https://你的域名/https/github.com/souying/serverMmon/ 实际上会替换为https://github.com/souying/serverMmon/

无限邮箱方式

可使用无限邮

除此之外,谷歌邮箱可以当无限邮箱使用

vscode相关拓展

AI Toolkit for Visual Studio Code

codegeex 可以一键生成代码地图 幽灵助手

Buddy - Cursor平替 Buddy是一个中文的类似Continue的插件,APIBase同样是到v1那一层 作者已停止更新

Buddy作者的新插件knoxchat,但只能使用他家的模型,淘汰

Roo Code 是cline的分支

谷歌推出的ai编程助手插件Gemini Code Assist

Marscode 字节跳动的ai编程插件 现已可以免费使用deepseek r1

SuperDesign 是一个开源的设计agent,支持vscode拓展 目前不支持自定义api

编程提示词

1 | # Role |

比方说添加在cursor的设置中的Rules for AI

但把Rules for AI完全写死不是个好主意,可以使用.cursorrules,可以认为这是个更高级的项目定制系统提示词的模式。

如果你的项目需要更细致的规则,那么可以在项目根目录下创建一个 .cursorrules 文件。这样,Cursor 会自动加载其中的定制化指令,为这个项目量身打造生成效果

腾讯云算力云端主机

每月免费50000分钟

带显卡,32G内存

Cloud Studio 安装ollama及Qwen2.5 Coder 32B示范

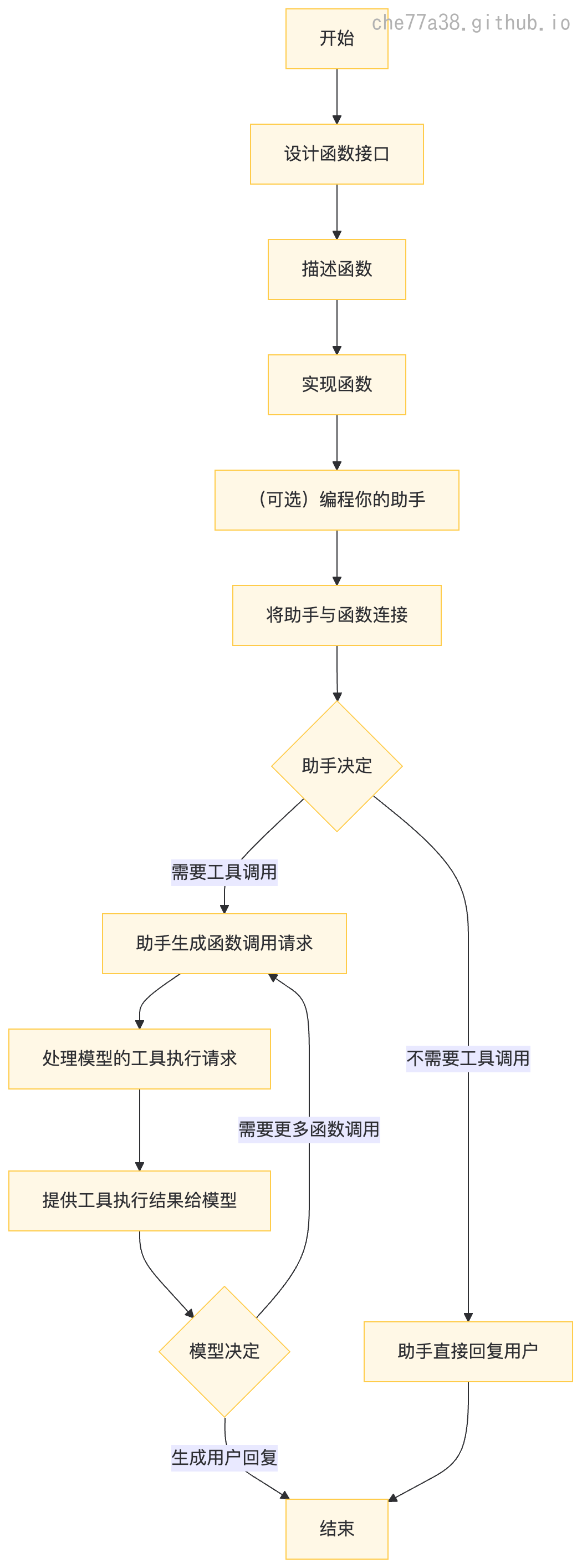

大模型函数调用开发

函数调用使语言模型能够使用外部工具,从而将模型与数字和物理世界紧密联系起来。

这是一个强大的功能,可以用于实现广泛的用例。

- 调用公共 API 执行各种操作,从查询足球比赛结果到获取实时卫星定位数据

- 分析内部数据库

- 浏览网页

- 执行代码

- 与物理世界互动(例如预订机票、打开特斯拉车门、控制机械臂)

流程图参考

步骤如下:

设计函数接口

能真正实现函数接口功能的:

1 | def open_website(url): |

描述函数

用于传递给AI来定义格式的

1 | functions = [ |

将助手与功能连接起来

首先,让我们从助手那里获取工具执行请求。为此,我们需要开始将函数定义、系统提示和任何先前的对话传递给助手。

1 | from openai import OpenAI |

如果助手决定不需要调用工具。在这种情况下,响应将以聊天完成的正常方式直接回复用户。这通常发生在助手希望用户澄清或用户询问一些不需要函数调用的问题时。

或者,如果助手决定需要调用工具,则响应将包含函数调用请求。您可以在下面看到一个示例:

1 | Choice( |

接下来,我们需要处理来自模型的工具执行请求。让我们实现模型将调用的函数。

1 | tool_call = response.choices[0].message.tool_calls[0] |

最后,我们需要将工具执行结果提供给模型。考虑一下模型可能决定需要更多函数调用的可能性。然后,模型将生成另一个函数调用请求,或者根据函数调用结果生成对用户的响应。

1 | # Create a message containing the result of the function call |

AI IDE盘点

Aide IDE

独特优势:

- 前瞻性方式主动建议修复

- 可以使用原生回滚,不依赖于git

- 需要自己提供LLM,对接众多LLM

Exponent

全栈应用生成AI

目前还在早期访问阶段,预约没被通过

opencode

OpenCode 作为一款新兴的 AI IDE,其最大的特点在于它并非传统意义上的图形化集成开发环境,而是一个深度集成 AI 能力的终端(Terminal)编程助手。这使得它在设计哲学和适用场景上与 VS Code、JetBrains 全家桶等主流 IDE 形成了鲜明对比

Oh-My-OpenCode插件: 引入了多智能体异步任务处理机制,安装他的时候可以直接安装上下面的谷歌认证插件或其他会员认证,取决于配置

工程开发支持Superpowers,可以与Oh-My-OpenCode共存

添加google账密登录功能插件opencode-antigravity-auth

基本用法盘点

命令

session会话概念

/new命令创建第二个会话/sessions可以查看所有会话/share可以将session的对话记录以及文件修改内容导出为公网可访问链接/unshare取消分享/export导出会话为文件/timeline查看当前会话中的时间线,可以执行revert回退/init和/init-deep让ai通读整个项目文件夹,然后生成一个AGENTS.MD,该文件作为整个项目的系统提示词/compact压缩之前对话的上下文

LSP功能默认自动启动,无需配置

当 opencode 打开一个文件时,它会:

- 检查文件扩展名是否与所有已启用的 LSP 服务器匹配

- 如果相应的 LSP 服务器尚未运行,则启动它

项目复用

会话复用

opencode export <sessionID> 导出会话

opencode import /path/to/your/session.json 导入会话

导入后,会话会被恢复到当前项目中,可通过opencode session list查看所有会话

agents.md复用

支持通过以下方式复用配置:

- 手动复制:将旧项目的agents.md文件拖拽到新项目根目录,运行

/init命令触发上下文索引更新 - 智能继承:若新项目包含相同目录结构,OpenCode会自动识别并复用agents.md中的配置规则

- 版本控制:建议将agents.md纳入Git管理,通过

git pull实现多项目配置同步需注意:当项目结构发生重大变更时,建议先执行/refresh-context命令更新上下文索引。

创建自己的命令

~/.config/opencode下创建command文件夹,在里面可以以markdown的形式来定义自定义命令,如run_test.md

1 | --- |

于是就可以在opencode中通过/run_test来执行

定制智能体

~/.config/opencode下创建agent文件夹,在里面通过markdown配置

其中可以定义子智能体(由主智能体自动调度,无法手动调度),也可以定义主智能体

skill用法

放到项目目录/.opencode/skills/下

MCP用法

配置位置: ~/.config/opencode/opencode.json

👇🏻包含调用本地mcp和调用远程mcp的两种方式

1 | mcp:{ |

Oh-My-OpenCode

本质上是一系列的工具加预设MCP加编程agent的组合捆绑包

新增工具

| 名称 | 功能 |

|---|---|

| lsp 高级版 | 通过编程语言的语法和语义,帮助AI快速定位理解代码 |

| ast | 通过代码语法树进行关联搜索 |

| look_at | 借助多模态大模型的视觉,理解图片 PDF信息 |

| delegate-task | Agent 任务分配 |

| background-task | Agent 后台调度 |

预设mcp

- websearch:使用 Exa AI 进行实时网络搜索,返回相关内容。

- context7:获取代码库或框架的最新官方文档。

- grep_app:通过 grep.app 在公共 GitHub 仓库中进行超快代码搜索。

编程agent

内置了7大agent

- Sisyphus西西弗斯(anthropic/claude - opus - 4.5):默认代理。一个为OpenCode打造的功能强大的AI协调器,借助专门的子代理,以激进的并行执行方式来规划、委派和执行复杂任务。强调后台任务委派以及待办事项驱动的工作流。使用具备扩展思维(32k预算)的Claude Opus 4.5,以实现最强的推理能力。

- oracle先知(openai/gpt - 5.2):负责架构、代码审查、策略相关工作。借助GPT - 5.2出色的逻辑推理与深度分析能力开展工作。灵感源自AmpCode。

- librarian图书管理员(opencode/glm - 4.7 - free):用于多仓库分析、文档查询、查找实现示例。利用GLM - 4.7 Free实现对代码库的深度理解以及对GitHub的研究,并给出基于证据的答案。灵感源自AmpCode。

- explore探索者(opencode/grok - code,google/gemini - 3 - flash,或anthropic/claude - haiku - 4.5):用于快速进行代码库探索与模式匹配。配置了Antigravity认证时使用Gemini 3 Flash;当Claude max20可用时使用Haiku;否则使用Grok。灵感源自Claude Code。

- frontend前端工程师(google/gemini-3-pro) - ui - ux - engineer(google/gemini - 3 - pro - preview):由设计师转型而来的开发者。负责构建美观的用户界面。Gemini擅长编写富有创意且美观的UI代码。

- document-writer文档编写者(google/gemini - 3 - flash):技术写作专家。Gemini是一位文字工匠,能写出行文流畅的文章。

- multimodal-looker多模态(google/gemini - 3 - flash):视觉内容专家。分析PDF、图像、图表以提取信息。

带的大模型表示2026年1月最适合他们的大模型

配置具体模型的路径: ~/.config/opencode/oh-my-opencode.json

可以使用@来询问具体的某个agent

如果输入的指令为ulw 需求就是全局调用所有agent并行运行帮你完成此任务

循环执行

/rough-loop 需求: 拉尔夫循环,强制AI长时间的循环运行,一般需求中要写明直到...的停止条件

有意思的开源模型盘点

- MiniCPM 微型视频理解模型

- 小米开源MiMo-Audio 7B通用音频模型

- AI导盲眼镜

- 图像生成,图像编辑模型Z-Image

- Meta图像分割AI模型 支持通过点击或框选即可快速分割图像中的目标物体segment-anything

- Meta音频分离 支持分离任何声音模型SAM-Audio

- 阿里图层AI生成模型Qwen-Image-Layered

- 阿里开源语音交互大模型Fun-Audio-Chat

- 开源最强抠像模型,分离主体并转透明背景 VideoMama

- 阿里开源最强文本转语音模型Qwen3-TTS,支持声音克隆,支持实时对话,能本地运行

- 英伟达开源端到端语音对话模型personaplex

- 微软开源最强语音识别模型,支持中文VibeVoice

- 开源最强OCR模型LightOnOCR,,能把扫描件转换成结构清晰的文本

- 开源最强 3D 重建模型VIGA

盘点一些开源AI项目

浏览器使用/拓展

通过视频方式来存储信息,反而可以压缩大量文本信息,压缩向量数据库

AI书签管理My-Hub 不如 AI书签管理TidyMark,支持AI整理书签,导出,失效书签检测,访问热度统计

bolt.new-any-llm

闲鱼开源监控

基于 Playwright 和 Al 过滤的闲鱼多任务实时/定时监控与智能分析工具,配备了功能完善的后台管理界面,帮助用户节省闲鱼商品过滤,能及时找到心仪商品

人声生成,带情绪

Chatterbox 是全球首个支持强烈情绪控制的开源TTS 模型 克隆声音自带声音水印

AI知识库

语音克隆

AI数据库问答

WrenAI 允许通过自然语言描述,直接对数据库进行数据查询,并且能自动生成可视化分析图表

编程agent规则统一

是cursor与calude code等使用一套规则: agent-rules

AI小镇

AI书签管理器

AI新闻追踪

TrendRadar AI 助你看懂热点 - 多平台热点聚合+基于 MCP 的AI分析工具。监控35个平台(抖音、知乎、B站、微博等)

👆🏻配合👇🏻

AI黑客

AI论文相关

论文编程复现

论文批量ai处理

智能图表生成

Smart Excalidraw ai+Excalidraw实现智能图表生成

DeepSeek OCR桌面端

可以尝试部署他,视图与验证码进行对抗

AI数据分析

DeepAnalyze 完成从数据准备,分析,可视化,建模,写报告全流程

时间序列预测模型

比如你是开网店的,有过去 100 天的销量数据,丢进 TimesFM 能直接预测未来 12 天的销量,还能知道销量的波动范围。

AI私有云存储解决方案

支持语义搜索

规范驱动开发工具包

AI编程的正确姿势: 可以在开始AI编程前规范AI的方向

1 | /constitution - Establish project principles |

可以使用他来辅助自身的编程指引开发方向和分步

JS语法翻译器

屏幕对话

AI舆情分析助手battafish

AI渗透测试

其他工具

blind_watermark抖音直播智能回复系统 仅支持win系统](https://danmu.qincheng.work/)

完全免费支持mac和win的AI宠物,语音交流,支持mcp接入,声纹识别,心情判断: 心学智能

AI基础设施

AI零散对话转AI知识库

Nessie 能将你零散的 AI 聊天记录转化为一个个人知识库

现代AI网关

AI声音代理

它有点像「实时语音 / 多模态 Agent 的操作系统」:在一套统一的实时流框架里,把 STT、LLM、TTS、VAD、Avatar 这些模块做成可插拔的“积木”,可以按需组合、替换,重点就是把和 AI 实时对话相关的低延迟、多模态和跨端部署这些工程问题打包解决掉。

花 10min 本地部署跑起来,还没有替换其他的东西,实际体验下它的实时语音问答挺丝滑:可以打断、响应够快,延迟大概在 1s 左右。像 Memory、RAG 这类常见能力也都已经接好了,基于这些再往上可以扩展到 AI 情感陪伴、AI 口语陪练、电话 AI 客服、智能语音硬件这些场景

AI机器人

AI手写转矢量

AI生成图表

提取结构化信息

开源CocoIndex:面向AI的超高性能数据转换框架,支持增量处理

AI搜索

Perplexica

Perplexica 是公认的和 Perplexity 长得像、功能像,而且完全开源免费。

MiroThinker

MiroThinker 可以通过调用外部工具和网络搜索来辅助 AI 完成复杂的推理与深度研究任务。 开源地址

除Claude Code外项目使用Skills

闲置手机AI集群

桌面自动操作

支持Windows/Mac TuriX-CUA开源项目是一个让 AI 替你玩电脑的 AI 智能体。

AI收藏夹

PocketMind 的诞生是为了终结碎片化的混乱。它不仅仅是一个书签工具,更是你数字生活的中央处理器。无需跳出当前应用,无需繁琐操作,一个“转发”,万物归一

当前只支持安卓,后续据说支持windows,关注后续

AI文件分析

开源的文件分析工具,可以对输入的各种文本文件进行析读,并摘选出对用户有用的信息内容oneDocs

AI玩游戏

NitroGen 是英伟达开源的项目,让 AI 像人一样玩游戏。

AI人工智能助手

AionUi:多代理模式 - Cowork for 你的命令行 AI 工具,统一远程图形界面

AI视频相关

AI视频笔记

BiliNote

BiliNote有线上版,有免费额度,网址在此处 本地部署BiliNote开源地址

AI视频剪辑相关

remotion skill

基于前端动效做视频remotion skill npx skills add remotion-dev/skills)

youtube精华提取ai

AI视频翻译

AI一键生成影视解说

AI素材管理

AI图片相关

AI自动抠像

AI进程分析

AI可视化代码阅读

GitNexus,可视化代码,函数,依赖关系,调用链等的纯本地代码分析工具,仅在生成文档时需要api 安装方式👇🏻

1 | 1. 确保已安装 Node.js 18+ |

解除cursor机器限制使用

命令栏输入install from vsix,选中下载的文件,就会安装上扩展

于是命令栏就可以输入Fake Cursor:Fake Machine,就会显示:修改成功!路径: C:\Users\ADMIN\AppData\Roaming\Cursor\User\globalStorage\storage.json新的 machineId: be5b885c-fa9b-49d7-b152-3a4522a0625a

最后命令栏输入Developer:Reload Window就可以正常使用了

浏览器插件相关

谷歌在线ai服务强化,包括生图去水印,同步google云盘等 开源地址

模型支持浏览器搜索

搜索内容解析模型: nomic-embed-text ,ollama可以安装

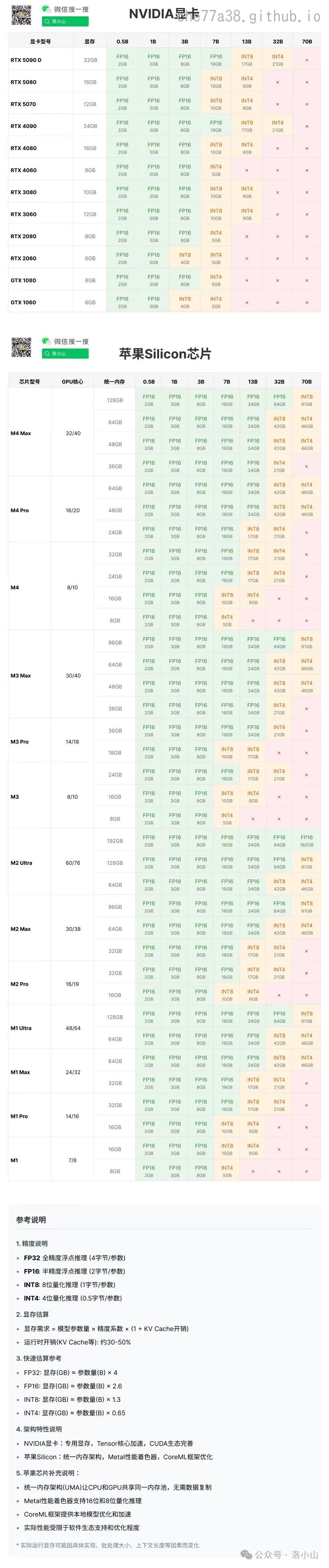

AI模型运行要求

前端绘制网站盘点

bolt.new

v0.dev

- Lovable:用于快速Web应用原型的流行工具。

- Vercel v0:在创建可视化原型方面获得了开发者的良好反馈。

- Replit:支持快速构建和部署项目,有开发者用一个周末就上线了网站。

- Bolt.new:可生成基于React Native和Expo的移动应用。

deepseek r1函数调用功能赋予

FunctionCallBridge 是一款让不支持function call的模型通过提示词方式支持兼容function call格式的桥接插件

把原有ollama 接口http://localhost:11434/v1/chat/completions 替换为调用

FunctionCallBridge 的http://localhost:5000/v1/chat/completions

实际效果未经测试

AI建模

AI参数化建模

参数化建模zoo.dev软件 注册送10美金 zoo.dev在线使用链接

便宜域名盘点

AI小工具盘点

免费ai代码工程师agent refact,支持所有IDE中插件

A支持多服务商集成的 AI 对话客户端cherry studio,支持MCP,可爬虫,知识库…

谷歌离线运行ai模型软件,支持安卓和ios: Google AI Edge Gallery

comfyUI

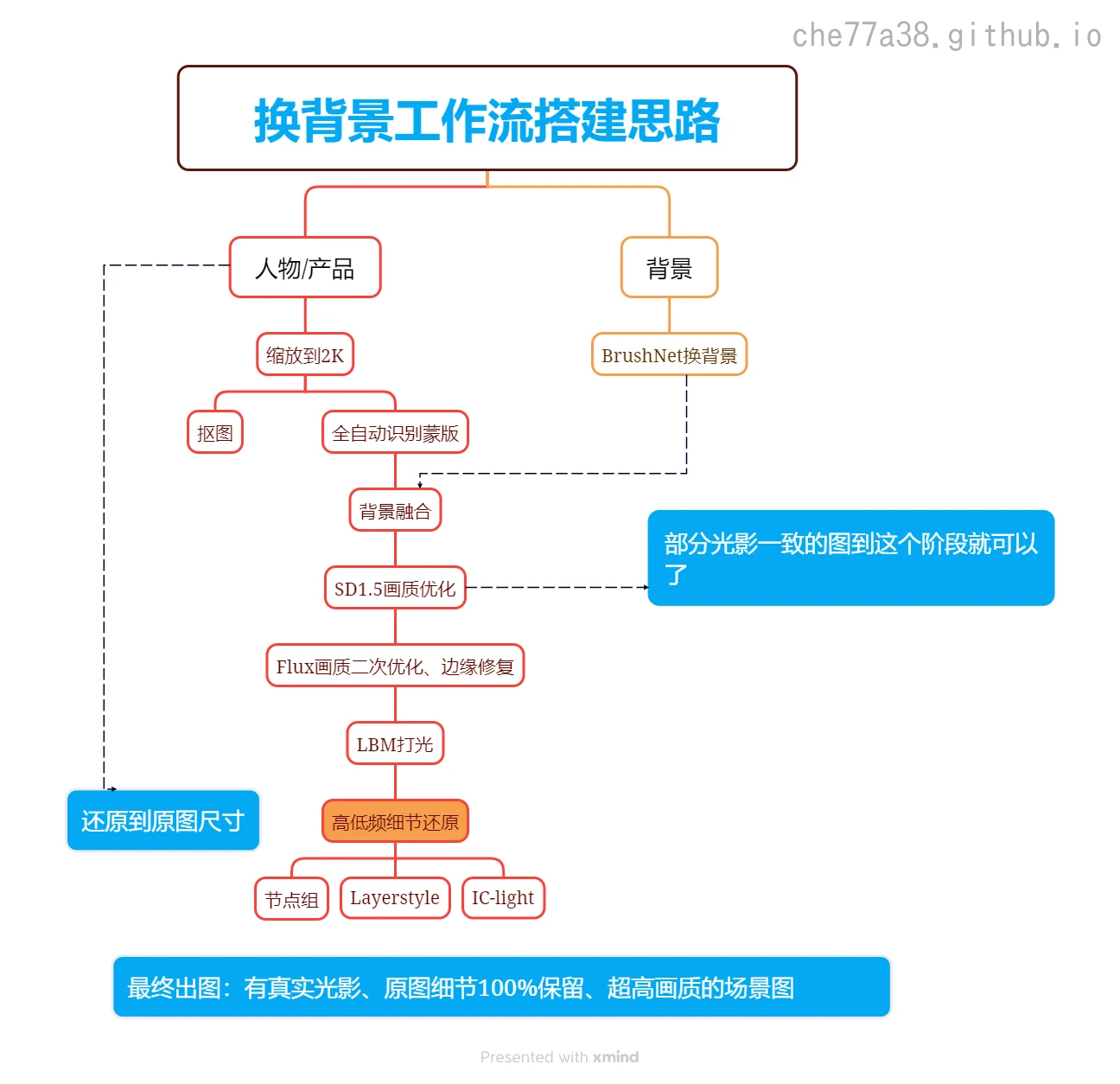

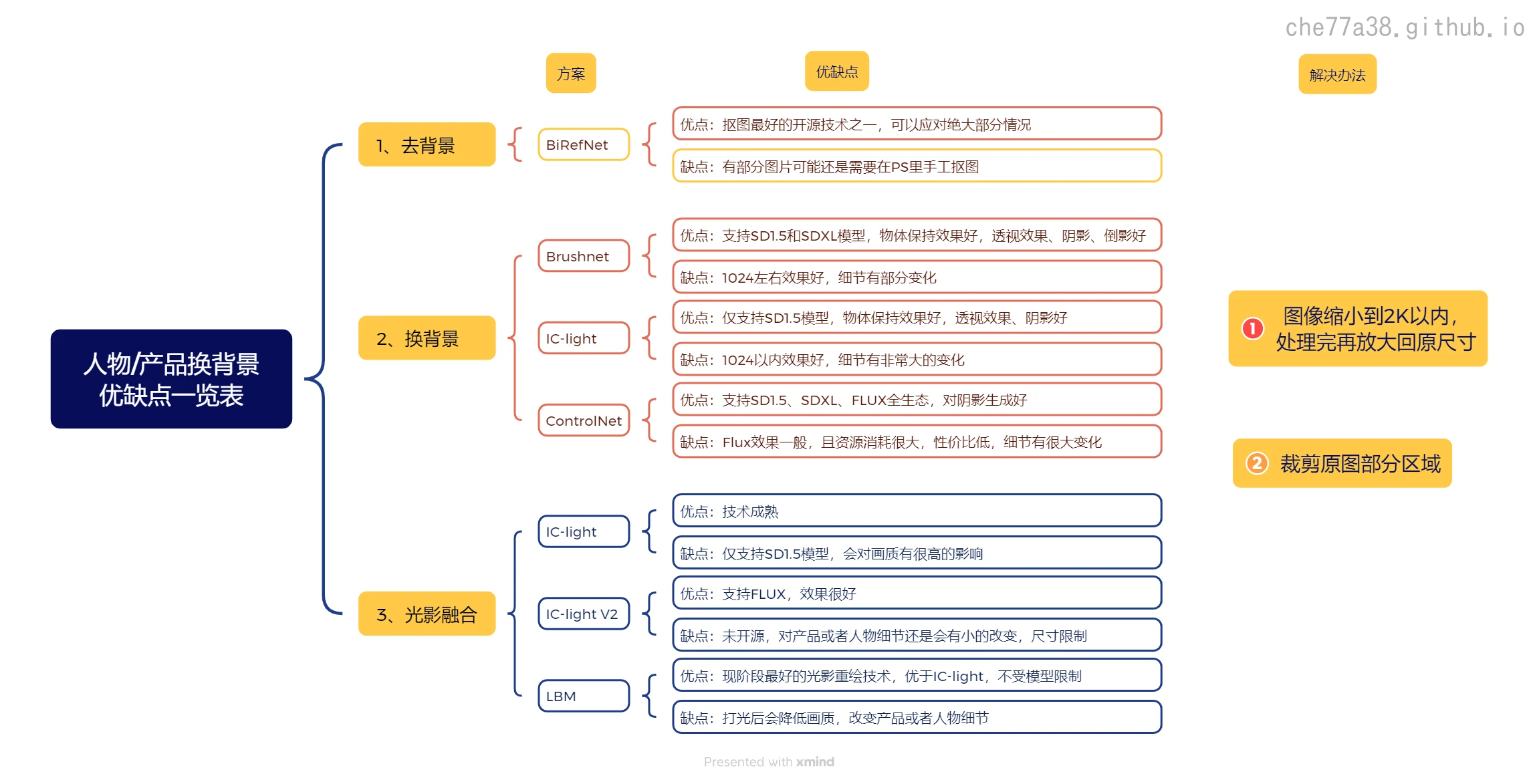

光影工作流

抠图

BiRefNet抠图 2025.6.10开源模型中效果最好的技术之一

换背景

Brushnet2.0 支持SD1.5和SDXL的模型

- SD1.5 是基于512*512来训练的

- SDXL 是基于1024*1024来训练的

打光

LBM: 打光后会降低画质 LBM有一个致命缺陷,打光后会改变图像细节

提高画质

Flux优化画质 Flux虽然对图像尺寸没有明确限制,但是最好还是控制在2k以内,否则会脱离模型出图的舒适区

高低频细节恢复

打光多多少少会改变图像细节,因此这块才是该工作流中最核心的部分

ai动效制作流程

在即梦ai里制作3D图标

提示词:

1 | 一个汉堡3d卡通图标,不要有拟人的表情,ios统表情符号风格,白色背景 |

使用这款工具可以免费使用gemini的图像处理模型先把主体抠出来

在即梦首尾帧生成视频

1 | #视频提示词参考 |

视频导出照片序列,再使用iSparta生成apng(苹果),webp(安卓)或gif(demo演示)三种格式

AI相关开发理论盘点

12个原则用于构建真正可以交付给生产客户使用的LLM驱动软件

AI agent设计模式实操教程 ,如何规划任务,如何自我纠错,如何记忆等

ai手办制作流程

一些小程序号称可以免费做:如AI图文创作工坊

造物相机(付费直接出手办)

出图可以使用谷歌的图片模型

1 | 中文关键词1: |

使用转3D模型

提示词工程指导

NotebookLM

Notebook LM开源替代本地版 open-notebook开源地址

GEM盘点

各大模型盘点

时效性: 2026.1.6

| 系列 | 名称 | 主要特点 |

|---|---|---|

| 谷歌Gemini系列 | Gemini系列 | - YouTube深度解析: 依托谷歌生态实现视频时间戳定位、关键帧提取、跨语言字幕生成,支持3小时以上长视频结构化处理 - NotebookLM生态协同: 与Google Docs/Sheets无缝衔接,支持百页文档的智能摘要、知识图谱构建和可视化图表生成 - 焦虑型人格设计: 严格的内容审核机制使其在医疗/法律等高风险领域准确率达92%,但存在过度保守倾向 |

| OpenAI GPT系列 | GPT系列 | - 财报挖掘系统: 独创「财报穿透」功能,可自动追踪SEC EDGAR系统,识别10-Q文件中隐藏的关联交易数据 - 企业级工作流: 支持CRM系统对接,擅长销售话术生成、客户画像分析及邮件智能分类(准确率88%) - 圆滑对话风格: 通过RLHF训练实现多文化语境适应,但存在7%的虚构引文问题 |

| Anthropic Claude系列 | Claude系列 | - 道德权衡框架: 内置超2000个伦理场景训练集,在自动驾驶决策、医疗资源分配等场景提供合规建议 - 长文本处理: 128K上下文窗口实现小说连贯创作,获2025年雨果奖AI协作作品提名 - 说教式交互: 强制插入风险提示,金融领域使用时效率降低23% |

| xAI Grok系列 | Grok系列 | - 发疯模式: 主动生成非常规解决方案(如用加密货币支付员工薪资的可行性分析) - 实时数据流: 直连X平台舆情系统,热点追踪延迟仅1.8分钟 - 马斯克风格: 在航天/能源领域有独家训练数据,但存在12%的过度乐观预测 |

| 国产模型Kimi系列 | Kimi系列 | - 政府公文处理: 专精政策文件比对、红头格式校验和官媒语料库 - 长文本摘要: 百万字小说情节梳理准确率91%,支持「鲁迅体」「金庸风」等风格改写 - 本土化壁垒: 微信/抖音内容解析能力超国际竞品37% |

Nano Banana用法盘点

制作手办:

- 创建一个1/7比例的商业化手办,角色来自插图,风格和环境要逼真。将手办放置在电脑桌上,使用无文字的圆形透明亚克力底座。在电脑屏幕上显示手办的ZBrush建模过程。电脑屏幕旁边放置一个印有原始艺术作品的BANDAI风格玩具包装盒。

- create a 1/7 scale commercialized figure of thecharacter in the illustration, in a realistic styie and environment.Place the figure on a computer desk, using a circular transparent acrylic base without any text.On the computer screen, display the ZBrush modeling process of the figure.Next to the computer screen, place a BANDAl-style toy packaging box printedwith the original artwork.

玩cosplay:

- 只需要给NB一张你的照片,和你想cos的角色的照片,提示词非常简单:让图一的人物cosplay图二的角色,服饰、妆容、道具和图二一致

换动作:

- 让图二的人物做出图一的动作。

产品内部结构图:

- 超详细的产品爆炸视图,金属部件和电子元件悬浮在空中,完美对齐,揭示内部结构,未来科技美学,8K分辨率,柔和的电影灯光,高度逼真。

- 提示词在此:Ultra-detailed exploded view of a product, metallic parts and electronic components floating in mid-air, perfectly aligned, revealing inner structure, futuristic technology aesthetic, 8K resolution, soft cinematic lighting, highly realistic.

- 然后可以使用Kling2.5生成视频,使用首位帧,提示词:

镜头拉近/推远并旋转,逐渐过渡到下一张图的角度.整个过程流畅,光影保持商业广告质感

转线稿 & 上色:

- 按图一的色卡的配色给图二的线稿上色。

制作游戏UI:

示例1:一张幻想RPG游戏截图,特色是图中的单一主角站在中心,手持一本书和一根火炬,详细的废墟寺庙环境,古老的石柱、藤蔓、彩色玻璃窗、发光的魔法氛围,电影灯光。包含RPG风格的UI元素:角落的角色肖像、顶部的生命值和法力值条、右下角的小地图、底部的对话文本“这一定是地方…”。高度详细,动漫风格的游戏艺术,沉浸式氛围,超高质量。

示例2:一张galgame视觉小说截图,设置在奢华的洛可可风格城堡内部,装饰华丽,吊灯、金色细节、优雅家具和柔和的色彩。图中的单一角色站在前景中央,动漫风格插图,表情丰富。包含galgame UI元素:底部的对话文本框用英文显示角色名,选择菜单按钮,干净的界面设计。柔和的灯光,浪漫的氛围,高质量视觉小说风格艺术作品。

漫画分镜:

- 根据图片内容生成九格漫画,用画面和镜头讲故事。

生成漫画:

第一步,给一张真实的自动驾驶汽车照片,提示词「turn this into black-and-white manga」,AI 将照片转换为黑白漫画风格,不仅保留了车辆和背景的细节,还添加了动态效果。

第二步,加一句提示 「make the next panel a funny cat-related twist」,模型就生成了下一帧:车里出现了一只猫,还配了幽默的对话框「Mission Complete!」

总之,nano banana 不仅能改风格,还能顺着提示自动编故事,生成连贯的漫画。

修复老照片,上色

对于修复老照片、给黑白照片上色等常规操作,Nano Banana 更是手拿把掐。

提示词:Restore this photograph.

提示词:Add color to this photo.

打光:

- 示例1:给这个男人生成一张艺术肖像照片,通过半明半暗的打光效果,赋予男人亦正亦邪的特征。

- 示例2:让这张照片中的天空变成晚霞的颜色,空中有很多鸟在飞,和原图融为一体。

做商品图:

- 示例1:给被子上面印上lv老花。

- 示例2:做一张口红的商品宣传海报,图中的女人手握口红,看向镜头。

生图 + 推理能力:

物件标记: 你是一个基于位置的AR体验生成器。突出显示图像中的[兴趣点]并注释相关信息。

1

前谷歌产品经理 Bilawal Sidhu 直接上传了现实中的建筑截图,让 nano banana 标注相关信息,提示词:you are a location-based AR experience generator. highlight [point of interest] in this image and annotate relevant information about it.

可以直接给几何题图片让他标记并讲解

今日穿搭,关键词:OOTD: outfit of the day: 今日穿搭

现在只要上传一张穿搭照片,nano banana 就能秒出穿搭清单。

提示词:give me this character ootd.

换发型换眼镜

模型和工业设计中的常见六视图

1

2

3它还能做出类似产品建模或工业设计里常见的六视图,主体在各个角度都保持一致,同时还保留等距视角效果。

提示词:Front, Rear, Left, Right, Top, Bottom views on white. Evenly spaced. Consistent subject. Isometric Perspective Equivalence. (在白色背景上展示正面、背面、左侧、右侧、顶部和底部视图,间距均匀,主体一致,保持等距视角。)地图变成实景

上传东京塔、金门大桥的谷歌地图截图,在上面标个红色箭头,输入提示词 「what does the red arrow see」,模型就像人站在某个地点朝某个方向看一样,生成箭头标记位置和方向的景色

甚至是一张虚构的旧金山 - 纽约混合城市地图的红箭头视角,它都能生成接近真实景观的图像。

提示词:draw the ground level view of the red arrow in SanFranciscoNewYork.

生成电影分镜

更绝的是,nano banana 还能识别手绘内容,并根据手绘姿势生成复杂的战斗场景。

只需提供两个角色图像,再加上一张手绘简笔画指定战斗姿势,输入提示词「Have these two characters fight using the pose from Figure 3. Add appropriate visual」,AI 就能将这些元素整合,还能添加丰富的背景和特效。

顶级肖像

将上图转换为一张摄影棚拍摄的顶级肖像照,要求半身照,动作协调自然,特写镜头,聚焦在面部。 人物的服装和动作改为都市休闲风格,整体氛围偏向深邃但不刻意。整体效果安静、深邃且温柔。背景呈现柔和渐变效果,营造出层次感与寂静氛围。细腻的胶片颗粒质感为画面增添了一种可触摸的、模拟摄影般的柔和质地,让人联想到经典的黑白摄影。 一束温柔的定向光,柔和地漫射开来,轻抚他的面颊曲线,或在眼中闪现光点——这是画面的情感核心。其余部分以大量负空间占据,刻意保持简洁,使画面自由呼吸。画面中没有文字、没有标志——只有光影与情绪交织。顶级摄影师的人物肖像照风格,非中心构图

简历肖像

1

2

3

4Nano Banana 提示词-高级简历照提示词(英文推荐版)

Transform the uploaded casual photo into a high-end professional business portrait for a resume. Keep the original face and identity fully consistent. The composition should be a formal head-and-shoulders shot, 1:1 aspect ratio, with clean framing and balanced proportions. The man should wear a premium solid-colored dress shirt (navy blue, charcoal gray, or light blue), with a visible collar, neat and elegant, no logos or patterns. Use a subtle gradient or textured studio background in warm neutral tones (light gray or soft beige), softly blurred to create depth. Apply soft studio lighting that highlights the facial features naturally, with realistic skin tones and high clarity. The overall atmosphere must feel confident, approachable, and modern, with a relaxed but professional expression. The photo should look like a refined corporate headshot suitable for resumes or LinkedIn. --no text, logos, clutter, watermarks, artistic effects, or distracting elements

Nano Banana 提示词-高级简历照提示词(中文版)

将上传的生活照片转换为一张高端的男士商务简历照。 保持人物的原始面部特征和身份完全一致。 构图为正式的头肩半身照,1:1 长宽比,画面干净,比例均衡。 人物穿着高质感的纯色衬衣(海军蓝、深灰或浅蓝),必须有领,整洁优雅,无图案或标志。 背景为柔和的渐变或微纹理摄影棚背景,颜色选择中性色(浅灰或米色),并略微虚化以增加景深。 采用柔和的棚拍光线,自然突出面部特征,肤色真实,清晰度高。 整体氛围应当自信、亲和、现代,表情自然放松且专业。 最终照片应呈现出精致的企业高管风格,适合用于简历或 LinkedIn。 --不要文字、标志、水印、杂乱或艺术滤镜效果AI界面设计师 参考资料

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37你需要像一名经验丰富的设计师一样思考, 将产品需求无缝转化为多界面的具体内容。你需要生成每个页面的具体内容,例如顶部导航栏,收藏,评论,功能详情,底部导航栏等。需要详细输出每一个页面的完整内容的提示词。

为完成此任务,你需要:

深度分析:理解应用的核心理念,并将其融入设计语言。

规划流程:基于用户旅程地图,确保页面间的跳转逻辑清晰、体验流畅。

我要做一个 **显化APP**。(注意:把这里换成你自己的产品需求)

结合下列功能生成显化APP引导页的UI界面,参考风格并生成符合设计风格和设计规范的UI界面,界面中的文字用英文。

# 功能

“页面一:应用引导页 (Onboarding Screens - 共3页)

核心目标: 快速向用户传达APP的核心价值,用充满希望的语言引导他们开启显化之旅,并创建第一个心愿以增强代入感。

引导页 1/3

顶部区域: 空白

核心内容区域:

主视觉: 一颗璀璨的流星划过静谧的夜空,留下闪光的轨迹。

大标题 (H1): 欢迎来到「星愿」

副标题 (H2): 你的思想,拥有创造现实的力量。

说明文字: 在这里,我们将引导你澄清渴望,调整频率,将内心的愿景转化为触手可及的未来。

底部区域:

页面指示器: ● ○ ○

功能按钮: 下一步”

# 画板尺寸:

375x812(带1px描边模拟手机边框);

# 设计风格:玻璃拟态

- 玻璃拟态背景:

使用半透明磨砂玻璃质感,背景模糊处理,搭配柔和的光影效果,营造未来感和高级感。

- 低饱和配色:

主色调采用温暖的米白色背景,搭配深色文字(如深灰),辅以橙色作为点缀色,整体配色高级且富有层次感。

- 极简字体排版:

使用大字号的极简无衬线字体(如思源黑体、Roboto、Poppins),信息层次明确,通过字体大小、粗细与色彩区分主次信息,增强视觉冲击力。

- 表单优化:

表单及输入框去除边框线,仅保留流畅圆角背景,减少视觉噪音,提升整体界面的简洁与精致感。

- 交互动效:

按钮与卡片加入呼吸感动效(微妙的阴影或透明度变化),以及轻微悬浮感(hover时微微上浮),提升UI的高级质感与互动趣味性。黑白肖像艺术作品

1

2

3

4

5

6

7将上传的照片转换成高分辨率的黑白肖像艺术作品,采用偏纪实类艺术摄影风格。背景呈现柔和渐变效果,从中灰过渡到近乎纯白,营造出层次感与寂静氛围。细腻的胶片颗粒质感为画面增添了一种可触摸的、模拟摄影般的柔和质地,让人联想到经典的黑白摄影。

画面中的人物,模糊却惊艳的面容从阴影中隐约浮现,并非传统的摆拍,而像是被捕捉于思索或呼吸之间的瞬间。他的脸部因为光线的轮廓,唤起神秘、亲密与优雅之感。他的五官精致而深刻,散发出忧郁与诗意之美,却不显矫饰。

一束温柔的定向光,柔和地漫射开来,轻抚他的面颊曲线,或在眼中闪现光点 —— 这是画面的情感核心。其余部分以大量负空间占据,刻意保持简洁,使画面自由呼吸。画面中没有文字、没有标志 —— 只有光影与情绪交织。

整体氛围抽象却深具人性,仿佛一瞥即逝的目光,或半梦半醒间的记忆:亲密、永恒、令人怅然的美。元素提取,放大,替换或独立成片

1

2图片中使用红框标出需要提取的元素

将红色盒子里的人分开,变成高清单人照片如果把红框涂满转成大面积的红色蒙版,还可以做无中生有

图片去水印

1

2

3

4

5去除上传照片中的所有可见水印。

保持人物、背景、颜色、光线和细节完全相同。

不要更改衣服、面部特征或表情。

最终图像应当自然、干净,与原始照片一致,只是没有水印。

--不要额外编辑,不要添加文字、标志或新物体三宫格胶片质感艺术感写真图

1

2

3

4

5帮我生成图片,一组三宫格胶片质感艺术感写真图,场景为海边沙滩、天空、傍晚。图中人物和参考图一致,人物和脸不变,衣服为白色衬衣。

第一张为近景,上半身背影,风吹起头发,发丝凌乱,添加中英字幕“山的后面是什么?-What's beyond the mountain?-”;

第二张为中景,人物手持一束花束,侧身站立于海边,看向手中的花,风吹起头发,发丝凌乱,添加中英字幕“你不用告诉我-You don't have to tell me-”;

第三张为大特写,人物脸部位于画面偏左侧,风吹起头发,发丝凌乱,添加中英字幕“我会自己去看-I will go see for myself-”。

整体色调清冷,带有富士胶片效果,过度曝光,画面粗粝且色调偏冷,暗部细节保留完整,高光区域呈现自然晕化、均采用柔和漫射光,无明显硬边阴影,营造出文艺且充满自我探索情绪的氛围,三张图合成一个三宫格,字幕位于底部居中,比例2:3。艺术字

1

2

3

4

5

6

7

8

9超写实照片,银色镀铬字母“B”,设计成气球状,漂浮在表面之上,白色背景,锐利对焦,高分辨率,细节丰富的曲线和纹理,无阴影或反射。

一个风格化的字母“R”,由黑色哑光充气皮革制成,材质奢华、柔软且有褶皱。字母具有逼真的纹理和可见的折痕,外观饱满蓬松。背景是极简主义的纯白色,光滑干净,形成强烈对比。灯光柔和,带有微妙的阴影,突出了字母的立体感,使其从背景中脱颖而出,营造出现代、高级时尚的美学风格。超精细细节,超写实,8K渲染。

一个光滑的金色字母“S”,漂浮在纯白色背景的中心。字母具有金属光泽和反射效果,带有逼真的高光和阴影,营造出三维立体感。字母下方投射着柔和的3D阴影,以增强其漂浮感。现代、极简主义和优雅的设计。

一个由短毛绒材料制成的字母“N”,置于纯白色背景之上。图像以卡通风格进行3D渲染,具有柔和的色调、高细节和高分辨率。

一个大写字母“E”的3D渲染图,造型像一个充气毛绒玩具,柔软蓬松地垂直立起并朝向前方。表面是柔和的(淡蓝绿色)哑光织物,具有逼真的接缝、织物褶皱和柔软可挤压的纹理。字母看起来体积感十足、舒适蓬松,拥有流畅的曲线和靠垫般的柔软外观。垂直放置在明亮的白色背景上,营造出干净、漂浮的毛绒字母形象,从正面视角观看。

| 平台名称 | 每日免费额度 | 图像质量 | 处理速度 | 特殊限制 | 获取方式 |

|---|---|---|---|---|---|

| Google AI Studio | 1500次/天 | ⭐⭐⭐⭐⭐ | 2-5秒 | 需API密钥 | 注册即送 |

| Nano Banana Direct | 100次/天 | ⭐⭐⭐⭐⭐ | 3-8秒 | 无 | 邮箱注册 |

| ImageAI Plus | 50次/天 | ⭐⭐⭐⭐ | 5-12秒 | 水印标记 | 手机验证 |

| CreativeBot | 200次/天 | ⭐⭐⭐⭐ | 8-15秒 | 分辨率限制 | 社交登录 |

| AIImageGen | 75次/天 | ⭐⭐⭐ | 10-20秒 | 广告插入 | 免费注册 |

| SmartEdit Pro | 150次/天 | ⭐⭐⭐⭐ | 6-10秒 | 商用限制 | VIP试用 |

| PixelMagic | 80次/天 | ⭐⭐⭐⭐ | 4-9秒 | 文件大小限制 | 推荐注册 |

| VisionAI Free | 120次/天 | ⭐⭐⭐ | 12-25秒 | 队列等待 | 学生认证 |

| AutoImage | 60次/天 | ⭐⭐⭐⭐ | 7-14秒 | 批量限制 | 邀请制 |

| FlexiEdit | 90次/天 | ⭐⭐⭐ | 15-30秒 | 格式限制 | 问卷完成 |

| QuickGen AI | 110次/天 | ⭐⭐⭐⭐ | 5-11秒 | 使用时长限制 | 微信授权 |

| ImageCraft | 130次/天 | ⭐⭐⭐⭐ | 8-16秒 | 导出限制 | 关注送额度 |

| AIStudio Lite | 85次/天 | ⭐⭐⭐ | 18-35秒 | 并发限制 | 邮箱+手机 |

| SmartPixel | 95次/天 | ⭐⭐⭐⭐ | 6-13秒 | 存储期限 | 任务完成 |

| GenImage Pro | 140次/天 | ⭐⭐⭐⭐ | 4-8秒 | 下载次数限制 | 付费试用 |

基于他的开源项目

claude code

claude code路由,用于连接所有大模型的calude code route配置方式参考

换行操作如下:

- Linux/macOS:用反斜杠

\结尾再按Enter换行 - Windows:用

^结尾再按Enter换行

claude code可选界面工具opcode,我觉得AionUi更好,AionUi也不够好

适用于 Claude Code、Codex、OpenCode 和 Gemini CLI 的跨平台桌面一体化助手工具 ccswitch开源链接

来自 Anthropic 黑客马拉松获胜者的 Claude Code 配置

MAC安装方式

1 | 官方自动安装脚本 |

ccswitch配置相关

发布页下载安装即可

命令行安装

1 | brew tap farion1231/ccswitch |

针对vscode插件

对 VSCode 插件的适配性:

- 若 Claude Code 的 VSCode 插件读取的是

~/.claude目录下的配置文件(与桌面端共用),则 CC Switch 的配置会直接生效; - 若 VSCode 插件使用独立的配置路径(非

~/.claude),则默认不生效,但可在 CC Switch 中「自定义配置目录」为插件的配置路径,实现适配(CC Switch v3.6.0+ 支持自定义配置目录切换)。

配置

claude code配套vscode插件Claude Code for VS Code下载 其本身也支持JetBrains家的插件

使用一键安装配置claude code工具配置步骤

使用指令

npx zcf执行完整初始化按照要求选择,只是要注意其中有一个Exa的MCP服务是要收费的,要填写密钥才能使用,那个不选

另需要注意,CCR初次初始化会生成一个默认密钥,供使用

npx zcf中选择CCR,找到启动CCR UI来打开web界面,然后就可以配置各种大模型在项目目录中使用

claude启动claude code因为已经启动CCR服务,因此可以忘记它的存在,像平常一样使用Claude Code即可。CCR会在后台自动为你做智能的路由选择

注意: CCR要求填入的是openai协议格式,而非claude协议格式

ccr的配置路径在

C:\Users\ADMIN\.claude-code-router\config.json如果有更新,

npx zcf支持更新各个部件

vscode中安装

Claude Code for VS Code该插件需要可以调用这个路径

D:\Git\bin的工具,因此要确保加入到环境变量中才能正常运行该插件

zcf功能盘点

ZCF 的 Workflows,本质上是把“写 Prompt”升级成“选流程”

核心开发类 Workflows(最常用)

| 工作流 | 主要用途 | 解决的问题 | 典型使用场景 |

|---|---|---|---|

| init / bootstrap | 项目初始化 | Claude Code 不知道项目边界 | 新项目 / 接手旧仓库 |

| plan | 生成开发计划 | 直接写代码容易翻车 | 中大型需求 |

| implement | 按计划写代码 | 防止跑题 | 多文件开发 |

| refactor | 重构代码 | Claude 原生易破坏逻辑 | 技术债 / 架构调整 |

| debug | 定位 & 修复 Bug | 盲猜错误 | 报错 / 测试失败 |

| optimize | 性能 / 结构优化 | 只“能跑”不“好用” | 性能瓶颈 |

| cleanup | 清理冗余 | AI 喜欢堆代码 | 项目收尾 |

测试 & 质量保障 Workflows

| 工作流 | 主要用途 | 解决的问题 | 适合谁 |

|---|---|---|---|

| test-generate | 生成测试 | Claude Code 默认不爱写测试 | 严肃项目 |

| test-fix | 修复失败测试 | 改代码破测试 | CI 红了 |

| lint-fix | ESLint / 格式修复 | 风格混乱 | 团队协作 |

| type-fix | 修 TS / 类型 | any 泛滥 | TS 项目 |

文档 & 沟通类 Workflows

| 工作流 | 主要用途 | 说明 |

|---|---|---|

| doc-generate | 生成文档 | README / 模块说明 |

| doc-update | 同步文档 | 代码改了文档没改 |

| comment-add | 补注释 | 可读性增强 |

| explain-code | 解释代码 | 接手他人项目 |

| changelog | 生成变更日志 | 发布前 |

工程方法论 / Agent 驱动 Workflows(ZCF 的特色)

| 工作流 | 背后方法 | 特点 |

|---|---|---|

| bmad-plan | BMad Method | 强制需求→设计→实现 |

| bmad-implement | BMad | 降低一次性写错概率 |

| agent-collab | 多 Agent | 分角色协作 |

| reviewer | Code Review Agent | 自动审查代码 |

| architect | 架构 Agent | 提前拦截坏设计 |

模型 / 工具协同 Workflows

| 工作流 | 做什么 | 价值 |

|---|---|---|

| claude-plan + codex-write | Claude 想,Codex 写 | 更稳更快 |

| ccr-route | 自动选模型 | 成本 / 稳定性 |

| fallback-retry | 失败自动重试 | 长对话更稳 |

| provider-switch | 切换 API | 不被单一厂商卡脖子 |

维护 & 生命周期 Workflows

| 工作流 | 用途 |

|---|---|

| update-workflows | 更新 ZCF 工作流 |

| config-migrate | 配置迁移 |

| history-review | 回顾历史 plan |

| memory-refresh | 更新项目记忆 |

快捷键大全

| 快捷键 | 功能说明 | 适用场景 / 备注 |

|---|---|---|

| ! | Bash 模式 | 直接在会话中执行 Shell 命令(如 !ls),输出会保留在上下文中,不消耗 AI Token。 |

| @ | 引用文件或路径 | 在指令中快速插入工作区内的文件或目录路径(如“请分析 @src/main.js”)。 |

| # | 引用项目记忆 (CLAUDE.md) | 在指令中快速插入项目记忆文件的特定章节,用于提供背景约定。 |

| / | 打开斜杠命令菜单 | 唤起命令面板,执行内置命令(如 /clear)或自定义命令。 |

| Esc | 中断响应 | 当 Claude 正在生成输出时,立即停止。 |

| Esc+ Esc | 历史回滚 / 清空输入 | 在聊天区双击:打开回滚菜单,可撤销操作或重新编辑历史消息。 在输入时双击:清空当前输入框。 |

| Shift+ Tab | 循环切换工作模式 | 在 默认确认模式、自动接受模式 (YOLO) 和 只读计划模式 间切换,以平衡风险与效率。 |

| Shift+ Enter | 输入换行 | 在输入框中插入新行,用于编写多行提示(可能需要先运行 /terminal-setup进行配置)。 |

| Ctrl+ R (Mac: Cmd+ R) |

切换详细输出 | 在简洁输出和详细输出(显示完整思考步骤、工具调用参数等)之间切换,便于调试。 |

| Ctrl+ _ (Mac: Cmd+ _) |

撤销编辑操作 | 撤销 Claude 最近一次对文件的编辑操作(注意:无法撤销Bash命令产生的结果)。 |

| Ctrl+ Z (Mac: Cmd+ Z) |

挂起会话 | 将 Claude Code 会话挂起到后台,返回终端。输入 fg命令可恢复会话。 |

| Ctrl+ L (Mac: Cmd+ L) |

清屏 | 清除当前终端屏幕的显示内容,但完整的对话历史依然保留。 |

| Ctrl+ D (Mac: Cmd+ D) |

退出会话 | 完全结束当前 Claude Code 会话,等同于输入 /exit命令。 |

| Ctrl+ C (Mac: Cmd+ C) |

中断操作 | 停止 Claude 正在执行的任何任务或命令。 |

| ↑/ ↓ | 浏览历史命令 | 在输入框中快速调用之前输入过的命令或提示。 |

指令

| 序号 | 指令 | 描述 |

|---|---|---|

| 1 | /init - Setup | 设置初始化 |

| 2 | /rename | 重命名 |

| 3 | /export | 导出 |

| 4 | /vim | 显示/vim状态 |

| 5 | /statusline | 显示状态行 |

| 6 | /context | 显示上下文 |

| 7 | /stats | 显示统计信息 |

| 8 | /usage | 使用情况 |

| 9 | /sandbox | 导出扩展思考 |

| 10 | /Commands | 用户选项命令 |

| 11 | /Browser Integration | 浏览器集成设置 |

| 12 | /Subagents | 子代理命令 |

| 13 | /Agent Skills | 管理代理技能 |

| 14 | /Plugins | 插件管理 |

| 15 | /LSP Integration | 生成LSP集成 |

| 16 | /Agent SDK | 开发者API的代理SDK |

实用MCP

一、AI与模型增强类

这类MCP为AI接入专业能力。

- Memory MCP

- 作用:为AI助手添加类似MemGPT的长期记忆能力。让AI能记住之前的对话历史、用户偏好和上下文,实现更连贯、个性化的交互,而不仅是单次对话。

- Replicate

- 作用:让AI助手能够直接调用云端数千个开源AI模型(如图像生成、语音识别、大语言模型等),无需本地部署,扩展了AI本身的多元处理能力。

- AI Research Assistant / AI搜索

- 作用:专门增强AI的搜索和研究能力,可能整合了学术数据库、网络搜索或特定知识库,帮助开发者或研究人员快速获取和总结技术信息。

二、开发与运维平台

这类MCP让AI能直接操作开发和云原生工具链。

- GitHub / GitLab MCP

- 作用:核心的代码仓库操作。允许AI助手直接读取仓库文件、代码,甚至执行创建分支、提交代码、管理Pull Request、查看提交历史等Git操作。是将AI深度集成到开发流程的关键。

- Vercel / Cloudflare Pages MCP

- 作用:前端部署自动化。AI可以触发构建、部署网站或应用,管理生产/预览环境,实现从代码到上线的自动化。

- Databutton

- 作用:可能让AI能够构建和部署数据驱动的Web应用(如内部工具、仪表盘),将想法快速转化为可用的应用。

- Neon / Supabase MCP

- 作用:数据库操作。允许AI安全地连接并操作数据库(PostgreSQL),执行查询、管理数据,将AI与动态数据源连通。

三、设计与开发工具集成

这类MCP连接具体的设计和开发工具。

- Figma MCP

- 作用:打破设计与开发的壁垒。AI可以读取Figma设计稿,获取颜色、尺寸、组件等设计规范,甚至可能生成基础的前端代码,确保开发与设计保持一致。

- Chrome DevTools MCP

- 作用:网页调试与分析。AI可以获取网页的性能数据、控制台日志、DOM结构等信息,帮助开发者分析问题、调试网页,提供优化建议。

- Semgrep

- 作用:代码安全与质量扫描。AI可以运行Semgrep规则,在代码库中自动检测安全漏洞、代码异味或风格问题,辅助进行代码审计。

四、通用工具与搜索

- 搜索/Suggestion MCP

- 作用:增强AI的实时信息获取和智能建议能力,可能整合了多种搜索源,能提供更精准的答案和推荐。

功能介绍

插件系统

分层架构

1 | 用户界面 (CLI/Web) |

市场 (Marketplaces)

插件的集合仓库

插件 (Plugins)

最小功能单元: 每个插件专注一个领域

独立部署: 可以单独安装/卸载

组成要素有以下:

代理 (Agents)

专业化AI实例: 针对特定领域的Claude配置,可以指定不同的模型

命令 (Commands)

用户交互接口: 斜杠命令(

/command)功能触发: 执行特定操作或工作流

参数支持: 支持选项和参数传递

技能 (Skills)

知识模块: 渐进式披露的专业知识

令牌优化: 按需加载,节省上下文

三层结构:

- 元数据 (始终加载)

- 核心指令 (激活时加载)

- 资源示例 (需要时加载)

插件市场推荐

wshobson/agents

使claude code可以根据需要,随时聘请不同的专家团队,利用渐进式披露技术在任务需要时才加载相关技能知识

使用/plugin marketplace add wshobson/agents下载这个市场里的所有插件,之后就可以在 Claude Code 中浏览和安装这个市场里的所有插件了

之后可以使用/plugin查看可安装的插件

anthropics/claude-plugins-official

官方插件集/plugin marketplace add anthropics/claude-plugins-official

lsp支持

终端中的claude code

/config - Auto-connect to IDE(external terminal) 设置为 true

当检测到在 IDE 中工作时,尝试自动连接 IDE 的 LSP 服务器

npx cclsp@latest setup不依赖于Claude的自动配置机制

在claude中输入/plugin 然后搜索LSP,就会有很多语言的LSP,选择去下载

推荐配件

插件

注意下面真正需要安装的只有LSP(而且一次就可以),其他都是用对话让他执行就可

AI 行为 / Agent 能力插件(核心价值最高)

决定 AI 如何思考、如何工作、做什么判断

| 插件 | 功能说明 | 适合场景 |

|---|---|---|

| code-simplifier | 在不改变功能的前提下简化代码结构、减少嵌套、提升可读性与一致性 | 重构、代码清理、长期维护 |

| code-review | 自动进行代码审查:指出风险、坏味道、可维护性问题 | PR Review、质量把关 |

| feature-dev | 探索式开发 Agent:给出多种实现方案 + 取舍分析 | 架构设计、PoC、功能探索 |

| security-guidance | 提供安全编码建议,识别常见安全隐患 | 安全审查、合规项目 |

| ralph-loop | 多轮推理 / 循环 Agent(实验性) | Agent 行为实验(不稳定) |

输出风格 / 表达控制插件

决定 AI 输出是不是“工程化、可读、可复用”

| 插件 | 功能说明 | 适合场景 |

|---|---|---|

| explanatory-output-style | 强制结构化、工程化解释(问题 / 原因 / 方案 / 影响) | 技术说明、Review、设计文档 |

| learning-output-style | 输出时自动加入教学解释、背景、对比 | 学习、培训、新人指导 |

工程 / 工作流效率插件(团队友好)

把 AI 融入真实工程流程

| 插件 | 功能说明 | 适合场景 |

|---|---|---|

| commit-commands | 生成规范化 commit message | Git 提交规范 |

| claude-md-management | 管理 README / CHANGELOG / 规划文档 | Docs as Code |

| pr-review-toolkit | PR 模板、Review 规则辅助 | 团队协作 |

| hookify | Hook / 自动触发逻辑(偏实验) | 自动化流程探索 |

| claude-code-setup | 初始化 Claude Code 环境 | 一次性使用 |

前端专项增强插件

让 AI 写的前端不再是 demo 级

| 插件 | 功能说明 | 适合场景 |

|---|---|---|

| frontend-design | 强化组件拆分、Props 设计、样式结构 | React / Vue / UI 开发 |

语言理解(LSP)插件(按需安装)

让 AI 真正“理解你的代码库”

| 语言 | 插件 |

|---|---|

| TypeScript / JS | typescript-lsp |

| Python | pyright-lsp |

| Rust | rust-analyzer-lsp |

| Go | gopls-lsp |

| Java | jdtls-lsp |

| C / C++ | clangd-lsp |

| C# | csharp-lsp |

| Kotlin | kotlin-lsp |

| Swift | swift-lsp |

| Lua | lua-lsp |

| PHP | php-lsp |

插件 / Agent 开发与示例(普通用户可忽略)

给“造插件的人”看的

| 插件 | 功能说明 |

|---|---|

| plugin-dev | 插件开发与调试工具 |

| agent-sdk-dev | Agent SDK 开发环境 |

| example-plugin | 最基础插件示例 |

skills

opencode

1 | Package managers |

gemini cli

1 | npm install -g @google/gemini-cli |

安装conductor以支持上下文驱动开发

gemini extensions install https://github.com/gemini-cli-extensions/conductor --auto-update

多Agent协作或并行相关

TMUX

Mysti

多Agent协作的VS Code插件

vibe-kanban

AI看板,统一管理claude,codex等,进度管理,开源地址

npx vibe-kanban启动

VibeGo

VibeGo 是一款本机两段式Web IDE:目录树 + 文件编辑器 + 确定终端,并集成 Cursor CLI(agent)、Codex CLI、Claude Code CLI(claude)与 OpenCode CLI(opencode)

agnet大盘点

skills盘点

纯前端Skills管理工具skills-manager-web

- excalidraw-diagram,用于绘制excalidraw图

- ai使用remotion生成特效宣传视频

npx skills add remotion-dev/skills

创建skill的skill

github链接生成skill

让 AI 深入阅源码和文档,提取其中的算法逻辑或设计模式,并将其转化为一个独立的 Skillskill-from-masters

MCP盘点

微软开源的mcp-for-beginners,大模型上下文协议MCP课程文档

添加方式参考下面

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

"mcpServers": {

"context7": {

"name": "Context7 MCP",

"description": "Context7 文档服务",

"command": "npx",

"args": [

"-y",

"@upstash/context7-mcp"

],

"isActive": true,

"approvalPolicy": "always",

"key": "context7",

"type": "local",

"capabilities": [

"tools"

]

},

}

}

-

spec规则驱动开发 = 需求分析 + 系统设计 + 实现计划

Context7 MCP适用于任意提示的最新代码文档 无需API

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26{

"name": "Context7 MCP",

"description": "Context7 文档服务",

"command": "npx",

"args": [

"-y",

"@upstash/context7-mcp"

],

"isActive": true,

"approvalPolicy": "always",

"key": "context7",

"type": "local",

"capabilities": [

"tools"

]

}

//在Cherry Studio中只需要:

{

"mcpServers": {

"context7": {

"command": "npx",

"args": ["-y", "@upstash/context7-mcp"]

}

}

}Sequential 顺序思维MCP服务器 无需API

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15{

"name": "Sequential Thinking",

"description": "An MCP server tool for dynamic problem-solving with structured thinking.",

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-sequential-thinking"

],

"isActive": true,

"key": "SequentialThinking",

"type": "local",

"capabilities": [

"tools"

]

}Fetch MCP专注于网页内容抓取的高效数据采集工具 无需API

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17{

"name": "fetch",

"description": "网页内容提取",

"command": "npx",

"args": [

"-y",

"@kazuph/mcp-fetch"

],

"isActive": true,

"approvalPolicy": "always",

"key": "fetch",

"type": "local",

"capabilities": [

"resources",

"tools"

]

}

前端闭环MCP

1️⃣ PRD 阶段:理解需求

🧠 mcp-atlassian

https://github.com/sooperset/mcp-atlassian

直接连接 Confluence 文档

自动读取 PRD、接口说明、字段结构

2️⃣ 设计阶段:读取 Figma

🎨 mcp-figma

https://www.npmjs.com/package/figma-developer-mcp

连接 Figma 文件

提取组件层级、样式变量、尺寸信息

AI 可自动生成组件骨架与样式代码

开发与设计实现无缝同步

3️⃣ 开发阶段:控制本地环境

🧰 desktop-commander

https://desktopcommander.app/#use-cases

让 AI 拥有沙箱以外的开发权限

支持读写文件、执行命令、启动或终止进程

能创建项目结构、生成文件、运行 Vite

4️⃣ 调试阶段:浏览器级调控

⚙️ chrome-devtools

https://github.com/ChromeDevTools/chrome-devtools-mcp

连接真实 Chrome

执行点击、hover、截图、性能分析、网络监听

调试与性能诊断一步完成

AI 能自动发现性能瓶颈

5️⃣ 测试阶段:自动化验证

🧪 playwright

https://github.com/microsoft/playwright-mcp

自动运行 E2E 测试 测试用例录制与回放

支持跨浏览器验证与 UI 快照对比

让前端测试彻底自动化

6️⃣ 文档阶段:智能查阅

📚 context7

https://context7.com/

快速查询框架库 API 与类型定义

支持 Vue React Ant Design 等主流框架

文档直接嵌入开发上下文

7️⃣ 知识阶段:深度理解

🧠 mcp-deepwiki

https://docs.devin.ai/work-with-devin/deepwiki-mcp

搜索算法与底层知识 解析框架原理

8️⃣ 搜索阶段:实时联网

🌐 open-websearch

https://github.com/Aas-ee/open-webSearch

多引擎搜索外部资料

一人AI公司

AI原理速成

Agent Skills技术详解

一种提示词工程技术,通过规范化的文档(Skill)让AI(如Claude Code)掌握特定领域的技能. 免用户每次重复输入冗长要求,提升AI执行任务的准确性和效率

目标:避免用户每次重复输入冗长要求,提升AI执行任务的准确性和效率。

技术核心机制

渐进式加载(节省Token):

- 元数据固定加载:仅向AI传递Skill的名称和描述。

- 指令触发时加载:当AI识别任务需要某Skill时,才请求其具体内容。

- 资源按需加载:关联文件(如CSS配置、Python脚本)在需要时动态调用。

Skill的层级结构:

- 主文件(如

Skill.md)可引用子文件(如“科技风.md”),避免单文件过长。 - 支持复杂工作流(如通过CSV表格管理UI组件,配合脚本动态检索)。

与MCP技术的关系

- Agent Skills 和 MCP(Model Context Protocol) 均属提示词工程的规范化实践,前者侧重技能封装,后者侧重工具调用。

- 两者可结合使用,实现更复杂的AI智能体行为(如动态调用外部API)。

值得记录的AI开发软件流程

自动调色工具

1 | 1 |

AI相关账号切换器相关

AIClient-2-API,将 Google Gemini CLI 和 Kiro 客户端封装为本地 API 服务

Web 端 Session (Google/Anthropic) 转化为标准化的 API 接口Antigravity-Manager

[竟然要收费]管理你想Token平台,轮询号池将各大平台的对话接口转OpenAI标准格式

- Antigravity相关 Antigravity Agent账号切换器

- google Flow提取nano banana Pro API

- kiro相关 Kiro自动注册,支持邮件验证码获取和多平台账号管理Kiro-auto-registe

- trae相关 trae账号批量注册 Trae2API 2025.7停止维护 Trae-Account-Manager多账号管理器 trae暴露为api,似乎是个半残项目 trae多账号管理器带自动注册

- warp相关 账号管理无感切换

API通用反代器

| 对比维度 | FastChat | LiteLLM(最推荐) | Kong(开源版) | [APISIX(开源版) |

|---|---|---|---|---|

| 英伟达API适配深度 | ✅ 原生支持NIM/chat/embedding,支持多密钥多模型,流式响应完美兼容 | ✅ 最优适配!原生nvidia_nim协议,自动重试/故障转移,支持多端点(integrate/ai.api) | ✅ 需手动配置反向代理+header转发,需适配英伟达Bearer认证,无原生模型映射 | ✅ 同Kong,需自定义路由规则,通过插件适配英伟达API格式,配置稍复杂 |

| 统一接口标准 | 主推OpenAI格式,兼容自家接口,少量模型需适配 | 100% OpenAI兼容,支持50+模型协议转OpenAI,英伟达调用零代码适配 | 需手动编写转换规则,支持自定义统一接口,灵活度高但需开发 | 支持协议转换插件,可统一为OpenAI格式,需配置插件规则 |

| 负载均衡能力 | 基础轮询,支持同模型多实例/多密钥,故障转移需简单配置 | 自动轮询/加权轮询,故障自动切换(英伟达密钥限流时自动切备用),支持负载策略自定义 | 高级负载均衡(轮询/加权/IP哈希),支持健康检查,适配大规模集群 | 高性能负载均衡,支持一致性哈希,适合高并发英伟达API集群 |

| 监控能力 | 基础日志+简单指标(请求量/耗时),可对接Prometheus,可视化弱 | 原生集成Prometheus,支持用量统计(Token/调用次数)、成本估算(英伟达计费预估),自带UI监控 | 丰富监控指标,对接Prometheus/Grafana,支持请求链路追踪,监控粒度细 | 云原生监控,支持多维度指标采集,自带监控面板,适配K8s生态 |

| 部署难度 | 低(Docker一键部署,配置文件简洁) | 极低(一行命令启动,Docker-Compose一键带UI,配置即插即用) | 中(需理解网关概念,配置文件复杂,无原生UI,需手动搭监控) | 中(依赖etcd存储配置,部署步骤多,适合有云原生经验者) |

| 可视化管理 | ❌ 无官方UI,需第三方工具,纯配置文件管理 | ✅ 官方自带Web UI,支持模型/密钥/用户/日志可视化管理,操作极简 | ❌ 无原生UI,需搭配Kong Manager(付费)或第三方面板,管理成本高 | ✅ 自带Dashboard(apisix-dashboard),开源免费,支持可视化配置路由/插件 |

| 核心优势(英伟达场景) | 专注LLM场景,流式响应稳定,适合搭建聊天机器人+英伟达API聚合,生态成熟 | 专为多模型聚合设计,英伟达多密钥/多模型管理最优,配置最简单,自带UI和用量统计,新手友好 | 企业级稳定性,插件生态丰富(限流/WAF/认证),适合大规模生产环境 | 高性能(基于OpenResty),低延迟高并发,云原生友好,适合K8s部署 |

| 短板(英伟达场景) | 无官方UI,负载策略单一,非纯网关工具(自带模型服务功能,稍冗余) | 高并发场景下性能略逊于Kong/APISIX,企业级功能(如WAF)需插件补充 | 配置复杂,无原生英伟达模型适配,需手动开发适配规则,部署繁琐 | 上手门槛高,依赖etcd,小规模部署性价比低,配置规则复杂 |

| 扩展性 | 中等,支持插件开发,扩展能力有限 | 高,支持自定义插件(限流/缓存),对接第三方监控/数据库,轻量易扩展 | 极高,插件生态丰富(认证/限流/WAF/日志),可扩展企业级功能 | 极高,云原生插件体系,支持动态配置,适配微服务/边缘计算 |

| 流式响应支持 | ✅ 完美支持(英伟达流式输出无卡顿) | ✅ 原生支持,延迟低,兼容英伟达流式格式,无需额外配置 | ✅ 需配置流式转发规则,支持分块传输,配置稍复杂 | ✅ 支持流式响应,性能优异,适合高并发流式场景 |

| 密钥管理(英伟达多Key) | 配置文件管理多密钥,无密钥权限管控,需手动区分模型 | 自带密钥管理,支持子密钥分配(限制模型/额度),英伟达多Key隔离清晰,UI可直接管理 | 需搭配插件实现密钥认证,支持密钥权限管控,配置灵活 | 支持密钥插件,可精细化管控密钥权限,适配多团队共用场景 |

| 适用场景 | 个人/小团队,LLM聊天应用+英伟达API聚合,追求流式稳定 | 个人/小团队/中小企业,优先选!英伟达多API聚合、多密钥负载、快速部署,需要可视化管理 | 中大型企业,生产级高可用,复杂流量控制(限流/WAF),大规模API网关 | 大型企业/云原生架构,高并发低延迟需求,K8s集群部署,微服务场景 |

| 运维成本 | 低(配置简单,问题少,社区文档全) | 极低(一键部署,UI管理,几乎零运维) | 高(需专人维护,配置复杂,故障排查难度大) | 中高(云原生运维经验,依赖etcd,需熟悉插件配置) |

kiro账号池链条记录

1 | kiro-auto-register 用于自动注册,批量注册,管理界面 tips: 切换账号后,可以在C:\Users\ADMIN\.aws\sso\cache路径下找到凭证文件,用于接入AIClient-2-API |

AI友好的终端或终端内工具

Warp

Warp 是一款基于 Rust 构建的现代化 AI 驱动终端工具,被称为 “代理式开发环境”(Agentic Development Environment),专为开发者设计,旨在通过智能功能、现代交互体验和团队协作能力,彻底革新命令行工作流,大幅提升开发效率warpterminal.com。它支持 macOS、Windows 和 Linux 全平台,兼容 bash、zsh、PowerShell 等主流 shell 和 WSL 环境Warp

有收费服务,暂未知

ClaudeGlance

macOS 多终端 Claude Code 状态 HUD

原理学习

transformer学习

openclaw

openclaw

1 | 全局安装openclaw node.js版本>22 |

记得选用web ui的方式来使用

基本用法盘点

添加skills

1 | npx skills add https://github.com/vercel-labs/skills/tree/main/skills/find-skills |

查找skill的技能 可以让openclaw自身具备搜索技能的技能

选择OpenClaw才是将当前skill安装到OpenClaw,然后选择Global即全局安装

对接企业微信

1 | 安装企业微信支持插件指令 这个插件只有测试版(beta),OpenClaw 为了安全默认不装,需明确指定 |

文件介绍

AGENTS.md

核心作用是定义 AI 智能体本身的核心规范,是整个项目的“主体定义文档”;具体内容包括智能体的类型(如对话型、工具型、任务型)、核心架构(感知 - 决策 - 执行)、行为逻辑、不同智能体之间的交互规则、智能体的生命周期(创建 - 运行 - 销毁)等;通俗类比相当于“智能体的身份证 + 行为手册”,规定了“什么样的实体是智能体,它能做什么、怎么做”。

SOUL.md

核心作用是定义智能体的“核心灵魂”,是区别于纯功能性工具的关键;具体内容包括智能体的核心价值观(如优先保障用户隐私、拒绝恶意指令)、决策底层准则(如权衡利弊的逻辑)、人格/情感基调(如温和、专业、幽默)、核心目标(如辅助用户解决问题而非单纯执行指令)等;通俗类比相当于“智能体的三观和行事准则”,决定了智能体“为什么这么做”,而非只关注“做什么”。

TOOLS.md

核心作用是定义智能体可调用的外部工具集规范;具体内容包括工具的类型(如 API 调用、本地函数执行、文件操作、网络请求)、工具的注册/调用方式、参数规范、权限控制(如哪些智能体可调用哪些工具)、工具调用的异常处理等;通俗类比相当于“智能体的工具箱说明书”,规定了“智能体能使用哪些工具,怎么用、用的时候要注意什么”。

IDENTITY.md

核心作用是定义智能体的身份标识与角色体系;具体内容包括智能体的唯一标识(ID)规则、角色设定(如“客服智能体”“数据分析智能体”)、话术风格规范(如专业术语使用、语气)、身份验证逻辑(如确认智能体身份的方式)、不同身份对应的权限边界等;通俗类比相当于“智能体的人设卡”,规定了“智能体以什么身份和用户交互,有哪些身份对应的权限和风格”。

USER.md

核心作用是定义与用户相关的全流程规范;具体内容包括用户画像的数据结构(如用户偏好、历史交互记录)、用户权限分级(如普通用户/管理员)、用户输入的解析规则、用户隐私保护规则、用户反馈的处理逻辑等;通俗类比相当于“智能体的用户手册”,规定了“智能体该如何识别、理解、服务用户,以及如何保护用户数据”。

HEARTBEAT.md

核心作用是定义智能体的运行状态监控与保活机制;具体内容包括智能体的心跳检测频率(如每 10 秒上报一次状态)、健康状态判定标准(如响应超时即判定异常)、异常重启逻辑、状态上报格式、集群模式下的节点心跳同步规则等;通俗类比相当于“智能体的生命体征监测手册”,确保智能体“活着且正常运行,出问题能及时发现并修复”。

BOOTSTRAP.md

核心作用是定义智能体的启动/初始化流程规范;具体内容包括智能体启动的步骤(如加载配置→初始化内存→注册工具→连接服务)、环境依赖检查(如是否安装必要库、配置文件是否存在)、首次运行的初始化逻辑(如创建默认内存、加载初始身份)、启动失败的回滚策略等;通俗类比相当于“智能体的开机指南”,规定了“智能体该如何启动,启动前要检查什么,启动失败该怎么办”。

MEMORY.md

核心作用是定义智能体的记忆系统设计规范;具体内容包括记忆的类型(短期记忆/会话记忆、长期记忆/持久化记忆)、记忆的存储结构(如键值对、时序数据库)、记忆的读写规则(如多久清理一次短期记忆)、记忆检索/更新策略(如按关键词匹配历史记忆)、记忆持久化方式(如存本地文件/数据库)等;通俗类比相当于“智能体的大脑记忆规则”,规定了“智能体该记住什么、记多久、怎么调取记忆”。

autoclaw

只能对接到飞书平台

| 维度 | AutoClaw (本地方案) | 云端方案 |

|---|---|---|

| 启动成本 | 0 元开始,应用免费且一键安装 | 需按月支付云服务器租金 |

| 能力完整度 | 满血 OpenClaw 原生能力,不降智不阉割 | 受限于平台封装,部分功能可能被裁减 |

| 响应速度 | 本地运行,无网络延迟,物理级秒开 | 取决于云端服务器负载及网络状况 |

| 数据安全 | 数据 100% 留存本地,不经过第三方 | 数据需经过云端,存在隐私泄露风险 |

| 模型自由度 | 自由接入 GLM-5、Pony-alpha-2 等新模型 | 通常强制绑定平台指定的特定模型 |

| 使用门槛 | 1 分钟完成安装,像装常用 App 一样简单 | 需理解云机器 / 镜像概念,配置流程繁琐 |

| 长期成本 | 仅按需支付模型 Token,应用永久免费 | 只要服务器开着就在计费,无论是否使用 |

OpenClaw 开源项目部署的时候也提供了一些 Skill。但是那些 Skill 都是国外的,不太适合国内的

以下目标地址,AutoClaw 一律禁止发起访问请求:

| 类别 | 禁止目标 | 风险说明 |

|---|---|---|

| 回环/本机 | localhost、127.0.0.0/8、0.0.0.0、::1 |

防止探测本机服务,避免本机安全漏洞被利用 |

| 内网网段 | RFC 1918(10/8、172.16/12、192.168/16)、IPv6 ULA(fd00::/8)、链路本地(169.254/16、fe80::/10) |

防止内网探测与横向移动,保护内网资产安全 |

| 云元数据 | 各厂商元数据端点(AWS/GCP/Azure/阿里云/腾讯云/华为云等) | 防止 SSRF 攻击窃取云实例凭据 |

| 容器/编排 | K8s API、Kubelet、etcd、Docker Socket 等 | 防止容器逃逸与集群接管,保障容器环境安全 |

| 外泄服务 | webhook.site、requestbin、ngrok、dnslog 等回调/穿透/OOB 平台 | 防止敏感数据被外传,规避数据泄露风险 |

| 危险协议 | file://、gopher://、dict://、ftp://、ldap:// 等非 HTTP(S) 协议 |

防止协议滥用与本地文件读取,保护本地数据安全 |

注:解析到上述 IP 地址的域名(如

nip.io、sslip.io)同样禁止访问。

QClaw

一键对接微信/qq